Secciones

Servicios

Destacamos

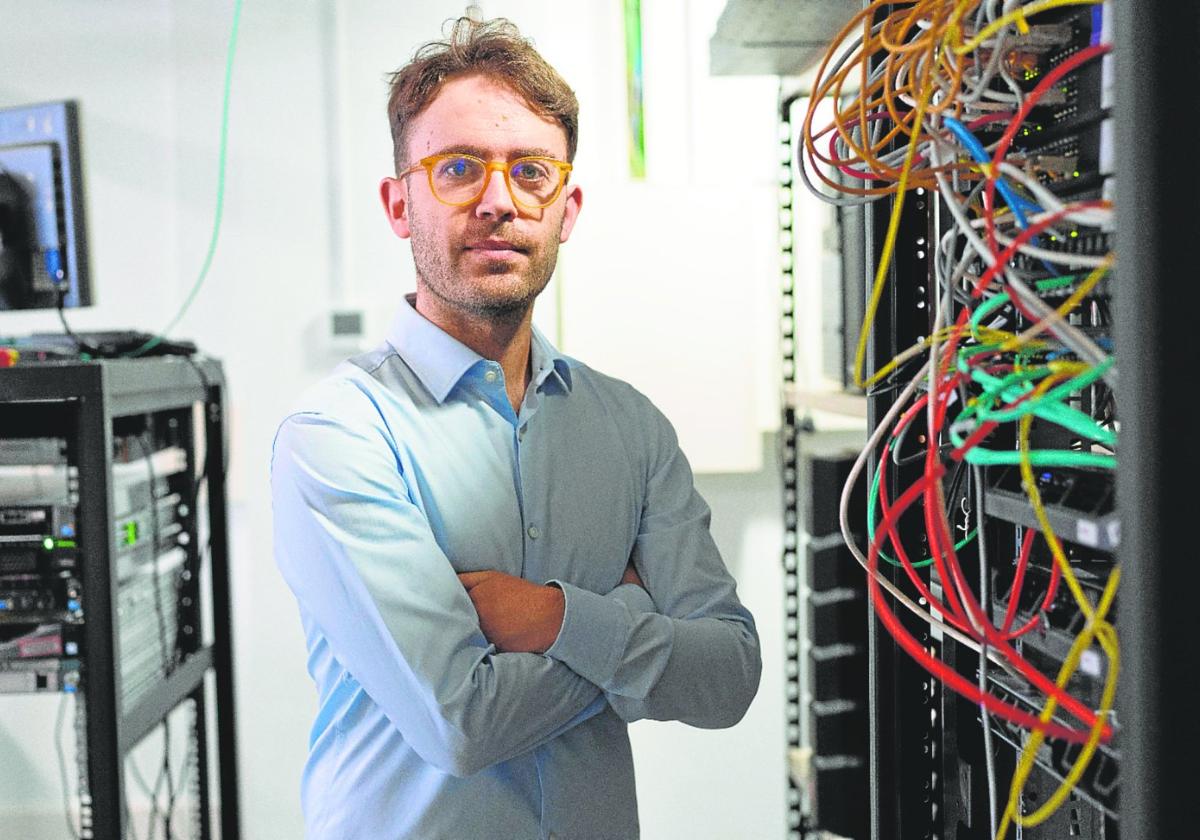

Este jueves se cumple un año del lanzamiento de ChatGPT, la herramienta del laboratorio de investigación estadounidense OpenAI que ha cambiado nuestra concepción del futuro. Este tipo de sistemas de aprendizaje basado en la inteligencia artificial (IA) «permite abrir un mundo de posibilidades reales que van desde la asistencia médica hasta la inminente conducción autónoma», describe el investigador de la Universidad de Murcia (UMU), José Luis Hernández Ramos, que acaba de recibir una de las prestigiosas becas Leonardo de la Fundación BBVA por su proyecto de aplicación de este tipo de tecnología con fines de ciberseguridad.

'Gladiator', como ha bautizado a su desarrollo, persigue ajustar y adaptar estas nuevas aplicaciones al ámbito de la lucha contra amenazas en el ciberespacio sirviéndose de la recopilación de fuentes de información relevantes sobre la materia. El intercambio de datos –sobre el que se basan los avances de la inteligencia artificial– no sienta bien a la ciberseguridad, donde la eficacia de la protección depende en buena medida de que los piratas informáticos no tengan acceso a los detalles del sistema empleado para repelerlos. De ahí que 'Gladiator', según explica su creador, «analizará el uso de técnicas de aprendizaje federado, que consiste en entrenar a múltiples dispositivos sin compartir datos entre ellos, para no tener que compartir la propia información de ciberseguridad».

De este modo, el agente nocivo se queda sin acceso a la información sobre amenazas y vulnerabilidades del sistema que pretende atacar.

«El objetivo –sintetiza Hernández Ramos– es que diferentes sistemas u organizaciones puedan crear o ajustar un modelo relacionado con ciberseguridad sin necesidad de compartir sus datos».

No tiene el mismo riesgo generar un texto con ChatGPT, precisa, «que dejar una vida o la propia seguridad humana en estas máquinas inteligentes». Su propuesta trata de usar sistemas de IA generadores de texto como ChatGPT o Llama (creado por Meta, la empresa responsable de Facebook, WhatsApp e Instagram) «para ayudar a mejorar cómo se maneja la información sobre ciberataques y vulnerabilidades en internet».

Profundizando algo más en el proyecto, Hernández Ramos apunta que se centra en el estudio, dentro del ámbito de la ciberseguridad, del potencial derivado del uso de lo que se conocen como modelos de lenguaje de gran tamaño (LLM, por sus siglas en inglés).

Herramientas tan populares basadas en estos modelos, como es ChatGPT, demuestran que los LLM «son especialmente útiles para procesar, entender y generar grandes cantidades de texto», explica. En este marco, la intención es «reforzar la capacidad de estos modelos para entender mejor el dominio de la ciberseguridad entrenándolos con información y datos específicos del dominio». «De esta forma –aclara– pueden ayudarnos en el análisis de información relacionada con amenazas o ataques de ciberseguridad, con el fin de mejorar nuestra capacidad para identificar actividades maliciosas y generar contramedidas más efectivas».

Se trata de una 'llave de judo' cibernético en toda regla, al aprovechar para repeler la agresión la misma potente fuente de la que se sirve el contrario para hacer daño. O, empleando otro simil, es como aprovechar la sabiduría del zorro para cuidar las gallinas que, en condiciones habituales, pretendería comerse.

«Este tipo de herramientas nos pueden ayudar no sólo a entender cuándo se ha producido un ataque, sino cómo, por qué y qué relación existe entre ese ataque y el contexto en el que se ha producido», detalla.

El estudio de las herramientas basadas en LLM y su potencial en el ámbito de la ciberseguridad se encuentra todavía en un estado incipiente, reconoce, «aunque el impresionante ritmo de desarrollo de estas técnicas probablemente impulse cada vez más iniciativas en este campo de investigación en los próximos años», augura Hernández Ramos. El interés por la aplicación en ciberseguridad de técnicas de inteligencia artificial lleva tiempo anidando en este doctor en Ingeniería Informática, si bien relata cómo «ante el impresionante auge de la IA generativa y el uso de LLM de los últimos años empecé a interesarme por su potencial en ciberseguridad, y me pareció que podría ser un campo de investigación prometedor».

El proyecto de 18 meses que acaba de arrancar (comenzó a finales de septiembre) considerará el uso potencial de técnicas de aprendizaje descentralizadas para impedir que los datos sensibles acaben en malas manos, lo que no resulta fácil en un entorno basado en gran medida en la fuerza que aportan los intercambios de información.

El proceso de entrenamiento o adaptación puede despertar preocupaciones de privacidad, admite. «Una vez superados los retos marcados –puntualiza–, los resultados derivados del proyecto pueden ayudar a reforzar la cultura de la ciberseguridad y a mejorar las capacidades de las empresas y organizaciones en este campo».

Las investigaciones en torno a estos asuntos, advierte, deben ser abordadas desde una perspectiva cada vez más multidisciplinar. «Hay que tener en cuenta que en las últimas décadas hemos pasado de no tener ordenadores personales a estar siempre conectados a través de nuestros dispositivos móviles», resalta Hernández Ramos.

Ahora, con la irrupción de la inteligencia artificial, a la que cualquier persona tiene acceso a través de herramientas como ChatGPT, «es necesario abordar aspectos sociales, legales y éticos con el fin de reforzar nuestra concienciación sobre la responsabilidad asociada al uso de la tecnología».

Un gran poder conlleva una gran responsabilidad, se podría resumir citando el antiguo aforismo que alude a la espada de Damocles, aunque muchos usuarios de estas nuevas tecnologías quizá lo conocen mejor como 'Principio de Peter Parker', por la película 'Spider-Man' de 2002.

El proyecto 'Gladiator' del investigador de la Facultad de Informática José Luis Hernández, acrónimo de la expresión en inglés 'Uso de modelos de lenguaje de gran tamaño para el análisis consciente de la privacidad de la información de ciberseguridad', es uno de los pocos seleccionados en la última edición de las becas Leonardo. De 1.116 solicitudes presentadas, únicamente 58 han accedido a la dotación global de 2,2 millones de euros de esta iniciativa dirigida a «investigadores en estudios intermedios de su carrera, entre 35 y 45 años, que se caractericen por una significativa producción científica, tecnológica o cultural».

El currículum del desarrollador de 'Gladiator' le sitúa en ese grupo de escogidos. Hernández es investigador Marie Sklodowska-Curie en ciberseguridad en el Grupo de Sistemas Inteligentes y Telemática (GSIT) de la UMU, donde también recibió el 'Premio Extraordinario de Doctorado' de la Facultad de Informática en 2017. Ha trabajado durante cinco años como oficial científico en la Comisión Europea (DG JRC), «donde ha contribuido a algunas de las iniciativas europeas más prominentes en ciberseguridad y ha servido como experto científico en diversos organismos europeos y nacionales», explican desde la UMU. Además, es coautor de más de 60 artículos sobre ciberseguridad y ha participado en diversos proyectos de investigación europeos.

Publicidad

Publicidad

Te puede interesar

La juzgan por lucrarse de otra marca y vender cocinas de peor calidad

El Norte de Castilla

Publicidad

Publicidad

Esta funcionalidad es exclusiva para suscriptores.

Reporta un error en esta noticia

Comentar es una ventaja exclusiva para suscriptores

¿Ya eres suscriptor?

Inicia sesiónNecesitas ser suscriptor para poder votar.